NVIDIA RTX vs GTX: в чем разница?

Если вы не в курсе последних новостей в мире аппаратного оборудования или только недавно заинтересовались сборкой своего ПК и думаете о приобретении видеокарты от Nvidia, то, несомненно, заметили, что упомянутая компания предлагает два разных на первый взгляд типа графических процессоров: GTX и RTX.

Итак, что же это все означает, в чем разница между моделями GTX и RTX, и какую из них стоит выбрать? Мы ответим на все эти вопросы, так что рекомендуем прочитать статью до конца!

Основы

Все игровые графические процессоры Nvidia принадлежат их собственному бренду GeForce, который появился в 1999 году с выпуском GeForce 256. С тех пор компания выпустила сотни различных видеокарт, а кульминацией стали три последних модельных ряда: серия GeForce 20, выпущенная в 2018 году, серия GeForce 16, выпущенная в 2019 году, и серия GeForce 30, выпущенная в 2020 году.

На сегодняшний день серии GeForce 20 и GeForce 30 состоят исключительно из графических процессоров RTX, а серия GeForce 16 – из видеокарт GTX. Итак, что же означают все эти буквы? На самом деле ни GTX, ни RTX, не являются аббревиатурами и не имеют конкретного значения как такового. Они существуют просто ради маркетинговых целей.

Nvidia использовала несколько похожих двух- и трехбуквенных обозначений, чтобы предоставить пользователям общее представление о том, какую производительность может предложить каждый графический процессор. Например, производители использовали такие обозначения, как GT, GTS, GTX, а также многие другие на протяжении многих лет, однако лишь GTX и новая RTX «выжили» до наших дней.

GeForce 20 / 30 против GeForce 16

Прежде всего мы должны отметить, что серии 20 и 16, то есть последние графические процессоры RTX и GTX, основаны на одной и той же микроархитектуре видеокарты Turing, которую Nvidia впервые представила в 2018 году. В свою очередь, серия 30 основана на новейшей архитектуре Ampere.

Однако, несмотря на то, что GeForce 20 и 16 основаны на одной архитектуре, 20-я вышла первой. После запуска в 2018 году, производители хотели сосредоточиться на расширенных функциях, которые могла предложить новая архитектура. Линейка состояла из графических процессоров верхней части среднего сегмента и high-end видеокарт, которые и могли продемонстрировать указанные функции, и это были первые модели под обозначением RTX.

Между тем, серия 16 появилась годом позже, потому что Nvidia нужно было предложить несколько более экономичных решений для тех, кто не мог позволить себе потратить больше 400 долларов на видеокарту. Эти графические процессоры, однако, не имели вышеупомянутых расширенных функций, поэтому сохранили старое обозначение GTX.

Тем не менее в настоящее время графические процессоры GTX действительно слабее, чем RTX, но так и было задумано самими разработчиками. Название RTX было введено в основном ради маркетинга, чтобы новые графические процессоры воспринимались как большой шаг вперед, как нечто действительно новое, а само обозначение было вдохновлено главной новой функцией, представленной в серии 20: трассировка лучей в реальном времени.

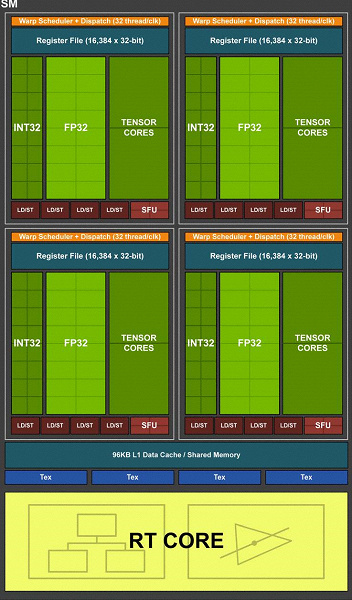

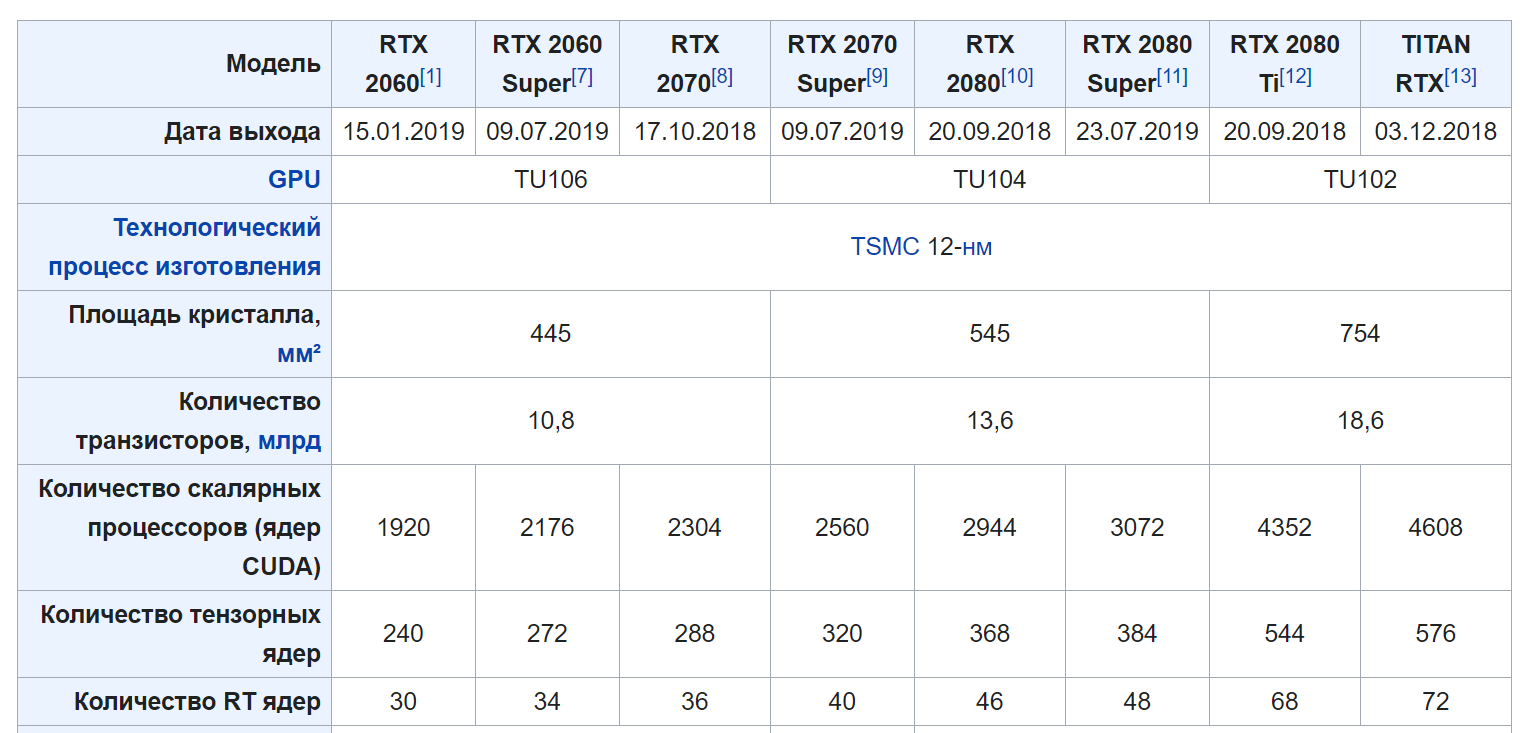

Сейчас трассировка лучей в реальном времени стала возможной благодаря RT-ядрам, которые встречаются только в сериях 20 и 30 и отсутствуют в моделях серии 16. Вдобавок ко всему существуют тензорные ядра, которые обеспечивают ускорение ИИ, а также повышают производительность трассировки лучей и обеспечивают суперсэмплинг глубокого обучения в играх.

Если убрать эти две ключевые характеристики из общей картины, видеокарты GTX 16 серии и графические процессоры RTX серий 20 и 30 не так уж сильно отличаются. Очевидно, что более дорогие модели RTX имеют больше транзисторов, больше ядер, лучшую память и многое другое, из-за чего они способны предложить лучшую общую производительность, чем более дешевые аналоги в лице GTX. Однако они не обязательно обеспечивают лучшее соотношение цены и качества.

Итак, что это за новые функции и стоит ли покупать графический процессор RTX?

Что такое RT ядра?

Как упоминалось выше, RT ядра представляют собой ядра графического процессора, предназначенные исключительно для трассировки лучей в реальном времени.

Так что же делает трассировка лучей с графикой видеоиграх? Технология позволяет добиться более реалистичного освещения и отражений. Это достигается путем отслеживания обратной траектории распространения луча, что позволяет графическому процессору выдавать гораздо более реалистичное моделирование взаимодействия света с окружающей средой. Рейтрейсинг по-прежнему возможен даже на графических процессорах без RT ядер, но в таком случае производительность просто ужасная, даже на флагманских моделях типа GTX 1080 Ti.

Говоря о производительности, трассировка лучей в реальном времени на самом деле сильно влияет на производительность даже при использовании с графическими процессорами RTX, что неизбежно приводит к вопросу — стоит ли вообще использовать данную технологию?

По состоянию на 2020 год чуть множество игр поддерживают трассировку лучей.

Видео выше показывает, как трассировка лучей выглядит в игре Control (2019): графические улучшения, обеспечиваемые трассировкой лучей, значительны. Однако функция сокращает показатель FPS вдвое, со стабильных 60 до 30, и это с высокопроизводительной видеокартой RTX 2070 Super!

Трассировка лучей в реальном времени — это важное достижение в области гейминга, которое в ближайшие годы значительно улучшит графику видеоигр. Тем не менее, на прямо сейчас аппаратное обеспечение недостаточно мощное, и разработчики еще не в полной мере используют потенциал функции.

Что такое тензорные ядра?

Несмотря на то, что трассировка лучей является наиболее «продаваемой» функцией графических процессоров RTX серий 20 и 30, архитектура Turing также представила еще одну важную новую функцию в основной линейке GeForce — расширенные возможности глубокого обучения, которые стали возможны с помощью специальных тензорных ядер.

Эти ядра были представлены в 2017 году в графических процессорах Nvidia Volta, однако игровые видеокарты не были основаны на этой архитектуре. Таким образом, тензорные ядра, присутствующие в моделях Turing, на самом деле являются тензорными ядрами второго поколения. Касаемо игр, то у глубокого обучения есть одно основное применение: суперсэмплинг глубокого обучения, сокращенно DLSS, который представляет собой совершенно новый метод сглаживания. Итак, как именно работает DLSS и лучше ли он, чем обычные методы сглаживания?

DLSS использует модели глубокого обучения для генерации деталей и масштабирования изображения до более высокого разрешения, тем самым делая его более резким и уменьшая искажения. Вышеупомянутые модели глубокого обучения создаются на суперкомпьютерах Nvidia, а затем приводятся в действие тензорными ядрами видеокарты.

Суперсэмплинг обеспечивает более четкое изображение, но при этом требует меньших затрат на оборудование, чем большинство других методов сглаживания. Более того, технология может заметно улучшить производительность при включенной трассировке лучей, что хорошо, учитывая, насколько высока производительность данной функции.

Однако, как и в случае с трассировкой лучей, список игр, которые в настоящее время поддерживают DLSS, к сожалению, довольно мал. Впрочем, это наверняка изменится в будущем.

Заключение

Что ж, пришло время подвести итоги: обозначение RTX было введено Nvidia в основном ради маркетинговых целей, из-за чего графические процессоры на архитектуре Turing 20-й серии выглядели как более крупное обновление, чем они есть на самом деле.

Конечно, RTX-модели оснащены крутыми новыми элементами, которые полностью раскроют свой потенциал в обозримом будущем, а что касается чистой производительности, новейшие видеокарты на архитектуре Ampere достаточно сильно опережают старые графические процессоры GTX на базе Pascal, которые продавались по примерно той же цене.

Принимая во внимание все вышесказанное, мы бы не сказали, что графические процессоры RTX стоит покупать только ради трассировки лучей и DLSS, поскольку производительность всегда должна быть на первом месте, особенно если вы хотите получить максимальную отдачу от своих денег. С другой стороны, эти технологии будут развиваться в ближайшем будущем, и через пару лет графические чипы GTX окажутся откровенно устаревшими. Если вы собираетесь приобрести новую видеокарту, то, возможно, стоит ознакомиться с данной статьей, где мы перечислили лучшие видеокарты, доступные на рынке прямо сейчас.

Считаю что трассировка лучей является не столь революционной функцией ради которой стоит обновляться на новое поколение, сколько её метод оптимизации под названием DLSS. Уже который год в сети плавают слухи что у NVIDIA в рукаве был припасён ход, позволяющий сделать реальный прогресс в плане оптимизации — но зная насколько сильно компания погрязла в маркетинге, ждать от них такого подарка «бесплатно» было бы максимально глупо, и по факту так и получилось.

Трассировка же стала тем самым триггером, который заставил их применить этот козырь, и как мы видим по тестам 2.0 версии — результаты действительно впечатляющие, а уж если и вовсе отключить Трассировку, то мы как раз и получаем тот самый долгожданный буст фпс в 2 раза, который к тому же ещё и умудряется «улучшать» картинку из натива… Просто фантастика.

У них в планах сейчас вообще стоит задача добиться включения поддержки DLSS по умолчанию на уровне настройки видеоадаптера через панель нвидии, но это ориентировочно должно быть в версии 3.0, а пока что только вчера вышло обновление под номером 2.1 которое добавляет режим «Ультра производительности» для Death Stranding — кстати есть ли по этому поводу тесты?)

Чего ждать в будущем? Первое время конечно всё будет сказочно — буст фпс в 2 раза это действительно круто, и только совсем глупые люди не будут таким пользоваться, особенно на самых бюджетных версиях RTX серии в виде 2060, которые были слегка быстрее и чутка дороже тех же 1660 версий, но по факту дадут двойной разрыв в производительности с ними.

Но почему же это чисто маркетинговая технология, которая по факту может работать на всех видеокартах, но нвидиа заботливо двигает её только под новые серии? Да потому что у неё есть аналог, и точно так же как и Crytek сделали свой софтовый вариант трассировки, AMD сделали на уровне софта аналог под названием FidelityFX. Естественно она получилась хуже, но тот факт что это всё базируется чисто на программном уровне — а не с фейковым использованием каких то там специальных ядер, намекает нам на то что кое кого сильно обманывают, но если всё таки довести до ума данную функцию и включить её поддержку на программном уровне — то AMD будет иметь серьёзный ответ на прорывные технологии предлагаемые Хуангом в 3 тысячной серии.

Как работает видеокарта NVIDIA? Разбор

Мы привыкли воспринимать видеокарты как дополнение к основному процессору. А бывают даже интегрированные видюхи. Но на самом деле. Видеокарта — это компьютер в компьютере, который выполняет намного больше операций, чем остальные компоненты системы. Смотрите сами:

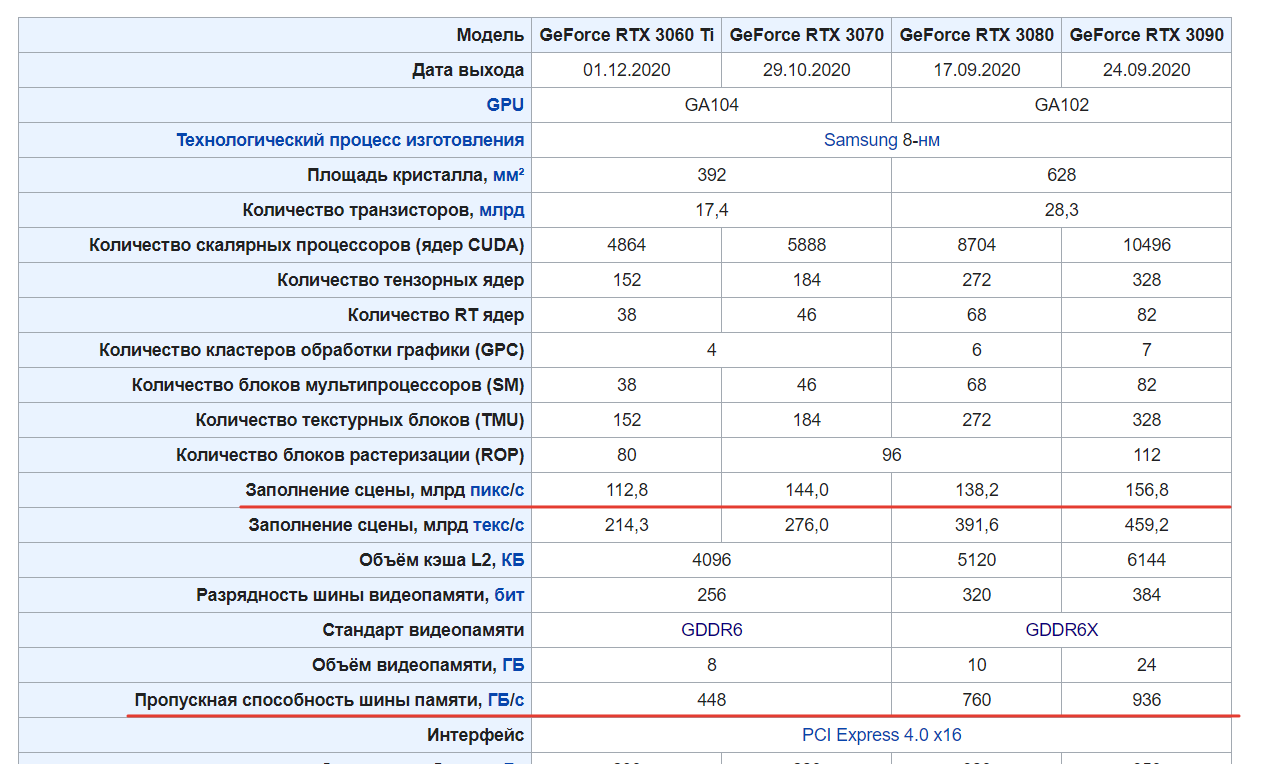

Вот например характеристики GeForce RTX 3090:

Но раз видюхи такие производительные, зачем нам вообще центральный процессор? И в чем всё-таки отличия CPU от GPU?

А чем видеокарты отличаются между собой? Как такая бандура помещается в ноутбук? И главное выясним, можно ли в играть в Cyberpunk 2077 на ноутбуке на ультра-настройках. Поговорим об этом и о многом другом в большом разборе!

Сейчас видеокарты много чего умеют делать и часто делают некоторые задачи куда быстрее и эффективнее CPU? Но к такому положению вещей мы пришли не сразу. Первые видеокарты было бы справедливо назвать ASIC-ками (Application-Specific Integrated Circuit), то есть интегральными схемами специального назначения. Что это значит?

Центральный процессор — это универсальный чип. Он может выполнять совершенно разного рода задачи. Всё потому, что каждое ядро центрального процессора — это много разных блоков, каждый из которых умеет делать свой тип вычислений.

Это удобно, потому как на центральном процессоре мы можем сделать любое вычисление. И в принципе, один огромный ЦП может заменить собой вообще все остальные чипы. Но естественно, это будет неэффективно. Поэтому для специфических задач на помощь центральному процессору часто приходят сопроцессоры или ASIC-ки то есть отдельные чипы, заточенные под эффективное решение какой-то конкретной задачи.

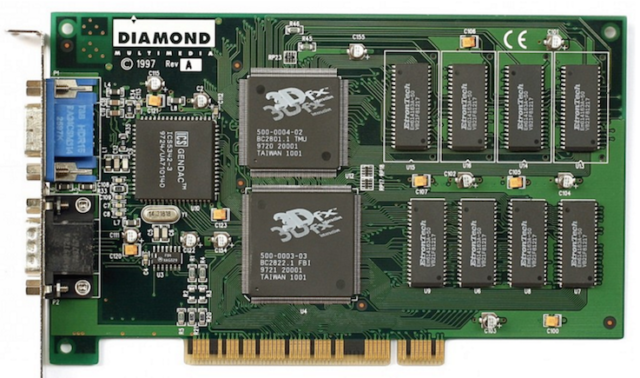

Так в середине 90-х такой конкретной задачей стало ускорение первых 3D-игр вроде Quake!

Первые видеокарты

Без ускорения Quake выглядел достаточно постредсвенно. Всё очень пиксельное и тормозное.

Но стоило прикупить себе волшебный 3D-акселератор. Подключить его к вашей основной 2D-видеокарте снаружи коротким VGA кабелем. Да-да, раньше это делалось так. И Quake превращался в нечто запредельное. Игра становилась, плавной, красочной, а главное работала в высоком для того времени разрешении и соответственно никаких пикселей.

Тогда это воспринималось практически как магия. Но за счет чего происходило такое кардинальное улучшение картинки? Чтобы ответить на этот вопрос, давайте разберемся как работает видеокарта поэтапно.

Как работает видеокарта?

Этап 1. Растеризация.

Трёхмерный объект изначально векторный. Он состоит из треугольников, которые можно описать вершинами. То есть, по сути, объект — это набор вершин, со своими координатами в трехмерном пространстве.

Но ваш экран двумерный, да ещё и состоит из пикселей. Так как нам отобразить векторный 3D объект в двухмерном пространстве? Правильно — спроецировать его!

Мы переносим координаты вершин на плоскую поверхность соединяем их при помощи уравнений прямых на плоскости и заполняем пикселями плоскости треугольников. На этом этапе мы получаем двухмерную проекцию объекта на экране.

Этап 2. Текстурирование

Дальше нам нужно как-то раскрасить модельку. Поэтому на растрированный объект по текстурным координатам натягивается текстура.

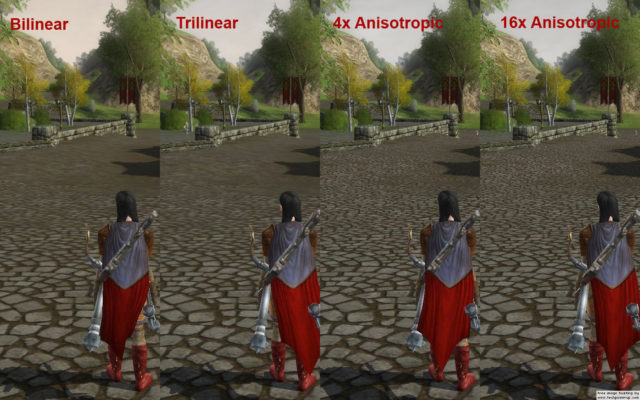

Но просто натянуть текстуру недостаточно, ее нужно как-то сгладить. Иначе при приближении к объекту вы просто будите видеть сетку текселей. Прям как в первых 3D-играх типа DOOM. Поэтому дальше к текстуре применяются различные алгоритмы фильтрации.

На первых видеокартах применялась билинейная интерполяция. Её вы и видели на примере с Quake. Всё, что она делает — это линейно интерполирует промежуточные цвета между четырьмя текселями, а полученное значение становится цветом пикселя на экране.

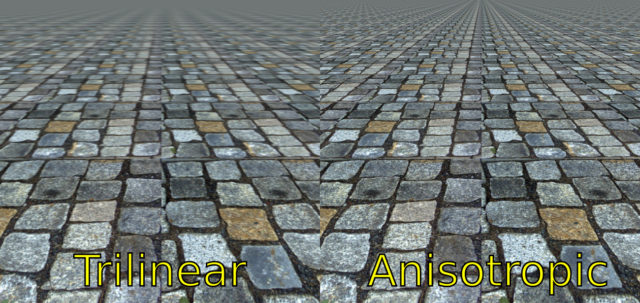

Такую интерполяцию активно используют используют и сейчас. Но в дополнении к ней также делают трилинейную интерполяцию — это еще более продвинутая версия сглаживания, но используют её только на стыках разных уровней детализации текстур, чтобы их замаскировать.

А вот чтобы вернуть четкости текстурам под углами к камере используют анизотропную интерполяцию. Чем выше её коэффициент тем четче получается картинка, так как для получения цвета каждого пикселя делается до 16 выборок. Особенно это заметно на поверхностях, находящихся под острым углом к камере. То есть, к примеру, на полу.

Окей, теперь мы получили цветное изображение. Но этого всё ещё недостаточно, потому как в сцене нет освещения. Поэтому переходим к следующему этапу с интригующим названием пиксельный шейдер или затенение пикселей.

Этап 3. Пиксельный шейдер.

Вообще шейдер — это штука, которая позволяет программисту что-то делать с вершинами, треугольниками и пикселями на программном уровне. В случае Пиксельных Шейдеров — это даёт разработчикам разработчиком возможность динамически менять цвет каждого пикселя экрана по программе.

Кстати, впервые поддержка простых шейдеров появились в 2001 году, когда появилась NVIDIA GeForce 3. До этого освещение тоже делалось, но аппаратными средствами и разработчики особо не могли влиять на результат. Так вот сегодня это самый ресурсоемкий этап, на котором для каждого пикселя нужно просчитать как он отражает, рассеивает и пропускает свет. Как ложатся тени по поверхности модели и прочее. То есть иными словами рассчитывается финальный цвет пикселя.

Каждый объект сцены описывается при помощи нескольких текстур:

Этап 4. Сохранение

После кучи вычислений при помощи информации из всех вышеперечисленных текстур наступает последний этап. Мы получили финальный цвет пикселя и сохраняем его в видеопамять. А после обработки всей сцены мы уже можем выводить картинку на экран.

Мощность

Все эти вычисления нужно проводить очень быстро и главное параллельно. Например, чтобы вывести 60 раз в секунду 4К-изображение нужно посчитать цвет примерно полумиллиарда пикселей. А если мы хотим 120 FPS — то целый миллиард. Именно поэтому видеокарты отличаются по структуре от центрального процессора.

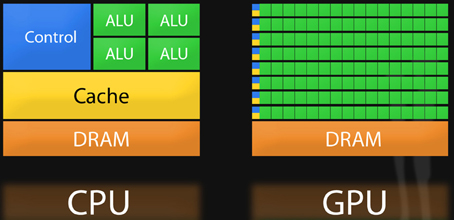

Центральный процессор заточен под последовательное, но очень быстрое выполнение множества разнообразных вычислений. Поэтому ядер в центральном процессоре мало, но зато они умеют быстро щелкать любые задачи. А вот в GPU вычислительных блоков тысячи, они не умеют максимально быстро выполнять задачи с небольшим количеством данных последовательно как процессор, но очень быстро делают параллельные вычисления с большим количеством данных. Например, NVIDIA GeForce RTX 3090 в пике может делать до 38 триллионов операций с плавающей точкой в секунду.

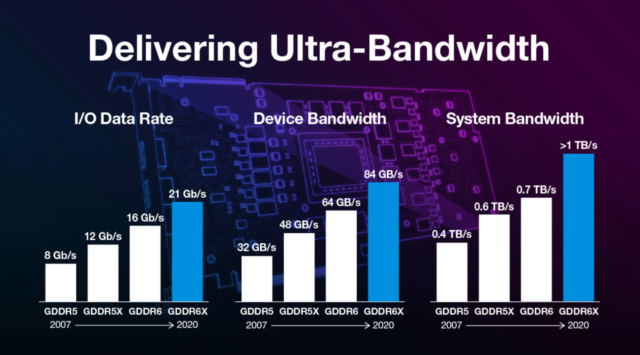

Так как видеокартам нужно постоянно загружать и выгружать огромное количество данных в память, то у них используется и свой тип памяти — GDDR. У неё выше задержки, чем в обычной DDR, поэтому такую память не имеет смысла использовать в качестве оперативной. Но у GDDR существенно выше ширина канала и пропускная способность, которая уже сейчас доходит до 1 ТБ в секунду.

Это позволяет видеокартам обрабатывать сотни миллиардов пикселей в секунду.

Вся эта мощь нужна только для того чтобы в игры играть? На самом деле — нет. Видеокарты уже давно используется для профессиональных задач.

Но стало это возможно только в 2006 году, когда вышла карточка GeForce 8800, в которой впервые появились ядра CUDA — Compute Unified Device Architecture. Это унифицированные ядра, которые впервые позволяли использовать видеокарту не только для игр, но и для любых массивных параллельных вычислений: типа рендеринга видео, симуляции воды, дыма, ну или майнинга крипты, если вдруг это еще актуально.

А в 2018 году, произошла другая революция — появилась архитектура Turing, а вместе с ней новые типы ядер и, конечно же, технологии трассировки лучей. Поговорим сначала о ней.

Трассировка лучей

Что такое трассировка лучей? Несмотря, на то что видеокарты за годы своей эволюции обросли поддержкой кучи эффектов. Игры действительно стали выглядеть впечатляюще круто. Но всё равно, остались выглядеть как игры. Почему?

Дело в том, что до появления технологии трассировки лучей, в играх не было настоящего глобального освещения. Оно рассчитывалось для каждого объекта по отдельности, причем поочередно. Соответственно, мы не могли рассчитать как объекты влияют друг на друга, как преломляется и отражается свет между разными объектами. А всё глобальное освещение сцены просто заранее «запекалось» в текстуру в графическом редакторе игры. Есть еще зонды и куча других техник, которые позволяют получить грубую имитацию глобального освещения с кучей недостатков — протеканием света сквозь объекты, повышенными требованиями к объему видеопамяти, отсутствием физики, так как если изменится положение объектов в сцене, то и освещение придется заново считать, а с использованием заранее подготовленных ресурсов — это невозможно.

А вот трассировка лучей впервые позволила, построить освещение по законам природы и сняла кучу ограничений. Ну практически. Как это работает?

Вместо того, чтобы поочередно считать освещение для каждого объекта Сначала выводится вся трехмерная сцена и упаковывается в BVH коробки для ускорения трассировки. После чего из камеры в упакованную 3D-сцену запускается луч и мы смотрим с какой поверхностью он пересечется. А дальше от этой точки строится по одному лучу до каждого источника освещения. Так мы понимаем где свет, а где тень.

А если луч попал на отражающий объект, то строится еще один отраженный луч и так мы можем считать переотражения. Чем больше переотражений мы считаем, тем сложнее просчет, но реалистичнее результат.

Всё практически как в жизни, но для экономии ресурсов, лучи запускаются не от источника света а из камеры. Иначе бы пришлось просчитывать много лучей, которые не попадают в поле зрения игрока, то есть делать бесполезные, отнимающие ресурсы GPU вычисления.

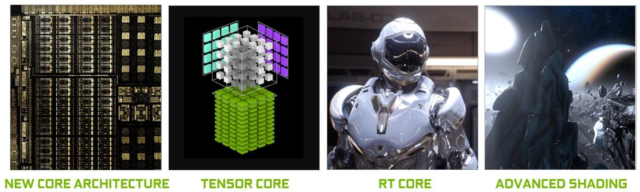

Новые ядра

Для реализации трассировки лучей, помимо ядер CUDA пришлось придумать ядра нового типа. Это RT-ядра, что собственно и значит ядра трассировки лучей и тензорные ядра.

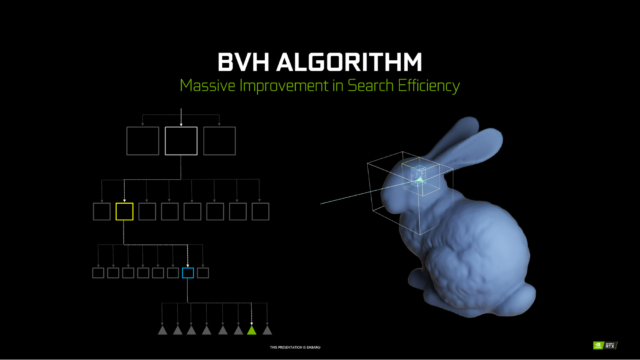

RT-ядра выполняют тот самый поиск пересечений между лучом и полигонами сцены. И делают это очень эффективно для благодаря алгоритму BVH — Bounding Volume Hierarchy.

Суть алгоритма: Каждый полигон вкладывается в несколько коробок разного размера, как в матрешку. И вместо того, чтобы проверять пересечения с каждым полигоном сцены, коих миллионы, сначала проверяется попал ли луч в небольшое количесчтво коробок, в которые упакованы треугольники сцены, На последнем уровне BVH матрешки содержится коробка с несколькими треугольниками сцены. Коробок намного меньше, чем треугольников, поэтому на тестирование сцены уходит намного меньше времени, чем если бы мы перебирали каждый треугольник сцены.

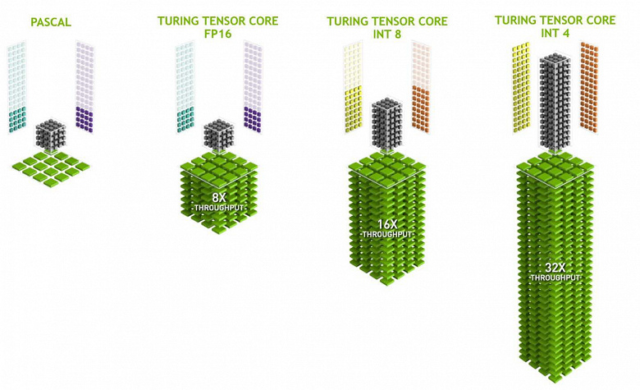

Тензорные ядра — это вообще необычная вещь для видеокарты. Такие ядра используется для операций матричного перемножения. То есть могут умножать много чисел одновременно. Это очень полезно для обучения глубоких нейронных сетей. Поэтому как правило, нейросети сейчас обучают и используют именно на видеокартах.

Но и в играх тензорные ядра имеют высокий вес. Во-первых, очищение рейтрейснутой картинки от шума в профессиональных пакетах с поддержкой OptiX.

Но в первую очередь, для реализации фирменной технологии DLSS — Deep Learning Super Sampling. Это технология сглаживания и апскейлинга картинки при помощи нейросетей. Например, у вас 4K-монитор, но видеокарта не тянет 4К на ультрах. Что в этом случае делает DLSS. Картинка рендерится в более низком разрешении 1440P или 1080P, а потом несколько соседних кадров объединяются нейросетью в новый кадр более высокого разрешенияи. Да так, что часто выглядит даже лучше чем в нативном разрешении. При этом мы получаем огромный прирост фреймрейта.

Многовато технологий! В таком можно и запутаться, поэтому чтобы упорядочить мысли давайте пройдёмся по этапам того как работает видеокарта.

Чем отличаются видеокарты?

Окей, кажется с принципом работы видеокарты разобрались. Теперь давайте поговорим почему одни видеокарты работают быстрее, а другие медленнее.

Во-первых, на скорость и возможности видеокарты влияет поколение. Например, до появления серии GeForce RTX 20-серии вообще не было трассировки лучей и прочих плюшек. Но если говорить о производительности в рамках одного поколения, то нас интересуют 4 параметра:

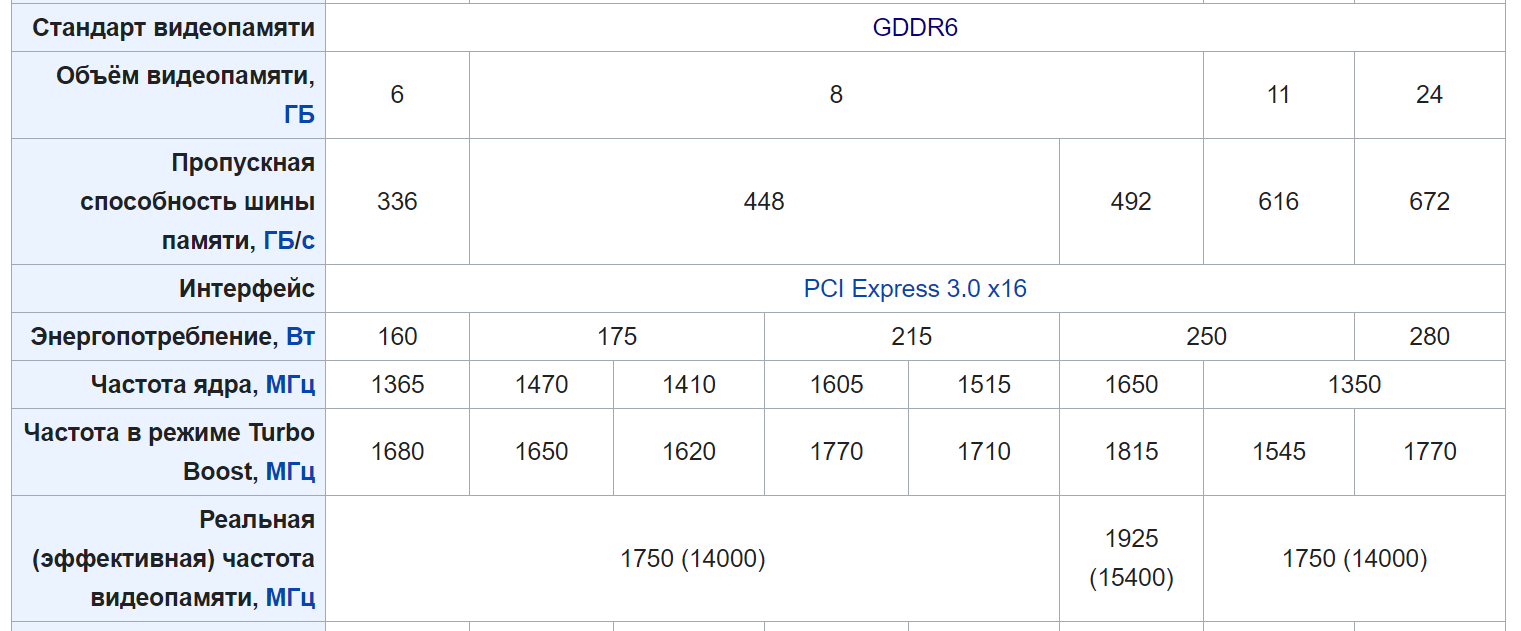

Допустим, сравним 20-ю серию.

Дизайн

Но причем тут дизайн?

Дело в том, что NVIDIA производит только чипы и показывает референсный дизайн видеокарты. А дальше каждый производитель сам решает какую систему охлаждения поставить и в каком размере сделать видеокарту. Соответственно, чем лучше охлаждение, тем выше будет частота работы, и больше производительность.

Но также под дизайном имеется ввиду формфактор. Дело в том что большие видеокарты, например, просто физически не влезут в ноутбук. А если даже влезут, энергопотребление в них будет запредельным. Поэтому существуют мобильные модификации видеокарт, которые просто распаиваются на материнской плате. Мобильные модификации карточек отличаются сниженными частотами и энергопотреблением.

Существуют две разновидности мобильных дизайнов:

| RTX 2080 Super | RTX 2080 Super Mobile (Max-P) | RTX 2080 Super Max-Q | |

| CUDA ядра | 3072 | 3072 | 3072 |

| Частота яда | 1650 МГц | 1365 МГц | 975 МГц |

| Частота в режиме Boost | 1815 МГц | 1560 МГц | 1230 МГц |

| Энергопотребление (TDP) | 250 Вт | 150 Вт | 80 Вт |

Проверим на практике

Производительность игровых лэптопов приблизилась к десктопной. Но ноутбуки более удобны в силу форм-фактора. GeForce GTX — это ок, нормальный начальный уровень. RTX — оптимальный выбор для любителей игр. Кроме того, RTX GPU — это еще и ускорение более 50 рабочих приложений. Рптимальный выбор для работы и игр. Но хватит теории. Давайте проверим на практике, чем отличаются по производительности разные карточки.

У нас есть 3 ноутбука. Вот с таким железом.

ASUS ROG Zephyrus G15

Ryzen 7 4800HS

NVIDIA GeForce GTX 1650 Ti 4ГБ

ASUS ROG Zephyrus G14

Ryzen 9 4900HS

NVIDIA GeForce RTX 2060 Max-Q 6ГБ

ASUS ROG Zephirus DUO

Intel Core i9-10980HK

GeForce RTX 2080 SUPER Max-Q 8ГБ

Во всех трёх вариантах установлены разные процессоры, но они все мощные, поэтому не должны сильно повлиять на результат тестов. По крайней мере бутылочным горлышком они точно не будут.

| GTX 1650 Ti Mobile | RTX 2060 Max-Q | RTX 2080 Super Max-Q | |

| CUDA ядра | 1024 | 1920 | 3072 |

| Частота ядра | 1350 МГц | 975 МГц | 975 МГц |

| Частота в режиме Boost | 1485 МГц | 1185 МГц | 1230 МГц |

| Тензорные ядра | — | 240 | 384 |

| RT-ядра | — | 30 | 48 |

| Объем видеопамяти | 4 ГБ | 6 ГБ | 8 ГБ |

| Энергопотребление (TDP) | 65 Вт | 50 Вт | 80 Вт |

И, для начала, немного синтетических тестов. Судя по тесту 3DMark Time Spy, 2080 Super в дизайне Max-Q опережает 2060 на 25%, а 1650 Ti на 51%. А значит мы ожидаем, что 2080 будет выдавать примерно в 2 раза больший фреймрейт. Посмотрим так ли это на практике.

Тест Cyberpunk 2077

Мы всё проверяли на Cyberpunk 2077 с версией 1.04 на не самой загруженной сцене, в закрытой локации. Тем не менее с наличием экшэна. Все ноутбуки работали в режиме производительности турбо.

Итак, в Cyberpunk 2077 есть 6 стандартных пресетов графики: низкие, средние, высокие, впечатляющие. И еще две настройки с трассировкой лучей: это впечатляющие настройки + среднее качество трассировки или ультра качество. В пресетах с трассировкой сразу же включен DLSS в режиме Авто. Это стоит учитывать.

Итак, на что способны наши видеокарты?

Во-первых, 1650 Ti показала себя очень неплохо, потому, что выдала супер играбельный фреймрейт на высоких настройках графики — стабильные 30+ FPS с редкими просадками до 25. А уж совсем играбельными оказались средние настройки — это уже 35-40 FPS.

Full HD, стандартные настройки

| Настройки графики | GTX 1650 Ti Mobile | RTX 2060 Max-Q | RTX 2080 Super Max-Q | ||||||||||||||||||||||||||

| Впечатляющее + RT: ультра + DLSS Auto | — | ||||||||||||||||||||||||||||

| Впечатляющее + RT: средне + DLSS Auto | — | ||||||||||||||||||||||||||||

| Впечатляющее |

| Настройки графики 1080P | GTX 1650 Ti Mobile | |||||||||||||||||

| Впечатляющее + RT: ультра + DLSS Auto | — | |||||||||||||||||

| Впечатляющее + RT: средне + DLSS Auto | — | |||||||||||||||||

| Впечатляющее | ||||||||||||||||||

| Впечатляющее + DLSS Качество | ||||||||||||||||||

| Впечатляющее + DLSS Ультрапроизводительность | ||||||||||||||||||

| Высокое + DLSS Сбалансированное | ||||||||||||||||||

| Среднее + DLSS Сбалансированное |

| Настройки графики | RTX 2080 Super Max-Q | |||||||||||

| Впечатляющее + RT: ультра (без DLSS) | ||||||||||||

| Впечатляющее + RT: ультра + DLSS Auto | ||||||||||||

| Впечатляющее + RT: средне + DLSS Auto | ||||||||||||

| Впечатляющее |

| Настройки графики | RTX 2080 Super Max-Q | |||||

| Впечатляющее + RT: ультра (без DLSS) | ||||||

| Впечатляющее + RT: ультра + DLSS Auto | ||||||

| Впечатляющее + RT: средне + DLSS Auto | ||||||

| Впечатляющее |

| Настройки графики | RTX 2080 Super Max-Q |

| Впечатляющее + RT: ультра (без DLSS) | |

| Впечатляющее + RT: ультра + DLSS Auto | |

| Впечатляющее + RT: средне + DLSS Auto | |

| Впечатляющее |