что такое transfer метод

transfer method

1 transfer method

метод замещения

—

[Я.Н.Лугинский, М.С.Фези-Жилинская, Ю.С.Кабиров. Англо-русский словарь по электротехнике и электроэнергетике, Москва]

Тематики

2 transfer method

3 transfer method

4 transfer method

5 transfer estimation method

7 transfer matrix method

8 transfer matrix method

9 transfer-line manufacturing method

10 transfer matrix method

11 transfer-function method

См. также в других словарях:

Transfer pricing — refers to the pricing of contributions (assets, tangible and intangible, services, and funds) transferred within an organization. For example, goods from the production division may be sold to the marketing division, or goods from a parent… … Wikipedia

Transfer-print — Transfer printing is a mass production method of applying an image to a curved or uneven surface. It is most commonly used for printing on porcelain and other hard surfaced pottery.Transfer printing evolved in England in the 1750s. The image is… … Wikipedia

Transfer molding — Transfer molding, like compression molding, is a process where the amount of molding material (usually a thermoset plastic) is measured and inserted before the molding takes place. The molding material is preheated and loaded into a chamber known … Wikipedia

transfer — trans·fer 1 /trans fər, trans ˌfər/ vt trans·ferred, trans·fer·ring: to cause a transfer of trans·fer·abil·i·ty /trans ˌfər ə bi lə tē, ˌtrans fər / n trans·fer·able also trans·fer·ra·ble /trans fər ə bəl/ adj trans·fer·or /trans fər ȯr, tr … Law dictionary

transfer printing — method of decorating pottery by using an inked, engraved copperplate to make a print on paper that, while still wet, is pressed against a glazed pottery surface, leaving behind an impression, or transfer, of the engraving. Sometimes these… … Universalium

Transfer-matrix method (optics) — The transfer matrix method is a method used in optics and acoustics to analyze the propagation of electromagnetic or acoustic waves through a stratified (layered) medium. [Born, M.; Wolf, E., Principles of optics: electromagnetic theory of… … Wikipedia

Transfer Pricing — Als Verrechnungspreis (bzw. Transferpreis oder Konzernverrechnungspreis) wird in der Kosten und Leistungsrechnung derjenige Preis bezeichnet, der zwischen verschiedenen Bereichen eines Unternehmens oder zwischen verschiedenen Gesellschaften eines … Deutsch Wikipedia

transfer — A change of ownership from one person or party to another. Bloomberg Financial Dictionary On the London Stock Exchange, the form signed by the seller of a security authorising the company to remove his name from the register, and substitute that… … Financial and business terms

Transfer-matrix method — In physics and mathematics, the transfer matrix method is a general technique for solving problems in statistical mechanics. The basic idea is to write the partition function in the form:mathcal

Transfer Learning: как быстро обучить нейросеть на своих данных

Машинное обучение становится доступнее, появляется больше возможностей применять эту технологию, используя «готовые компоненты». Например, Transfer Learning позволяет использовать накопленный при решении одной задачи опыт для решения другой, аналогичной проблемы. Нейросеть сначала обучается на большом объеме данных, затем — на целевом наборе.

В этой статье я расскажу, как использовать метод Transfer Learning на примере распознавания изображений с едой. Про другие инструменты машинного обучения я расскажу на воркшопе «Machine Learning и нейросети для разработчиков».

Если перед нами встает задача распознавания изображений, можно воспользоваться готовым сервисом. Однако, если нужно обучить модель на собственном наборе данных, то придется делать это самостоятельно.

Для таких типовых задач, как классификация изображений, можно воспользоваться готовой архитектурой (AlexNet, VGG, Inception, ResNet и т.д.) и обучить нейросеть на своих данных. Реализации таких сетей с помощью различных фреймворков уже существуют, так что на данном этапе можно использовать одну из них как черный ящик, не вникая глубоко в принцип её работы.

Однако, глубокие нейронные сети требовательны к большим объемам данных для сходимости обучения. И зачастую в нашей частной задаче недостаточно данных для того, чтобы хорошо натренировать все слои нейросети. Transfer Learning решает эту проблему.

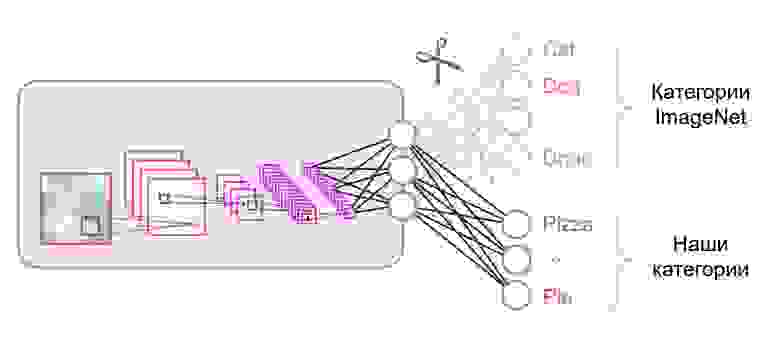

Transfer Learning для классификации изображений

Нейронные сети, которые используются для классификации, как правило, содержат N выходных нейронов в последнем слое, где N — это количество классов. Такой выходной вектор трактуется как набор вероятностей принадлежности к классу. В нашей задаче распознавания изображений еды количество классов может отличаться от того, которое было в исходном датасете. В таком случае нам придётся полностью выкинуть этот последний слой и поставить новый, с нужным количеством выходных нейронов

Зачастую в конце классификационных сетей используется полносвязный слой. Так как мы заменили этот слой, использовать предобученные веса для него уже не получится. Придется тренировать его с нуля, инициализировав его веса случайными значениями. Веса для всех остальных слоев мы загружаем из предобученного снэпшота.

Существуют различные стратегии дообучения модели. Мы воспользуемся следующей: будем тренировать всю сеть из конца в конец (end-to-end), а предобученные веса не будем фиксировать, чтобы дать им немного скорректироваться и подстроиться под наши данные. Такой процесс называется тонкой настройкой (fine-tuning).

Структурные компоненты

Для решения задачи нам понадобятся следующие компоненты:

В нашем примере компоненты (1), (2) и (3) я буду брать из собственного репозитория, который содержит максимально легковесный код — при желании с ним можно легко разобраться. Наш пример будет реализован на популярном фреймворке TensorFlow. Предобученные веса (4), подходящие под выбранный фреймворк, можно найти, если они соответствуют одной из классических архитектур. В качестве датасета (5) для демонстрации я возьму Food-101.

Модель

В качестве модели воспользуемся классической нейросетью VGG (точнее, VGG19). Несмотря на некоторые недостатки, эта модель демонстрирует довольно высокое качество. Кроме того, она легко поддается анализу. На TensorFlow Slim описание модели выглядит достаточно компактно:

Веса для VGG19, обученные на ImageNet и совместимые с TensorFlow, скачаем с репозитория на GitHub из раздела Pre-trained Models.

Датасет

В качестве обучающей и валидационной выборки будем использовать публичный датасет Food-101, где собрано более 100 тысяч изображений еды, разбитых на 101 категорию.

Скачиваем и распаковываем датасет:

Пайплайн данных в нашем обучении устроен так, что из датасета нам понадобится распарсить следующее:

Все вспомогательные функции, ответственные за обработку данных, вынесены в отдельный файл data.py :

Обучение модели

Код обучения модели состоит из следующих шагов:

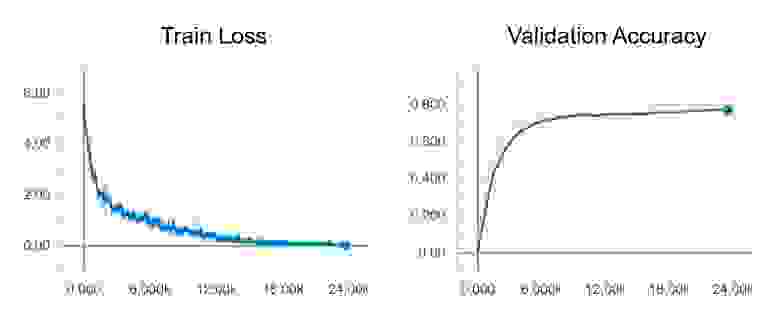

После запуска обучения можно посмотреть на его ход с помощью утилиты TensorBoard, которая поставляется в комплекте с TensorFlow и служит для визуализации различных метрик и других параметров.

В конце обучения в TensorBoard мы наблюдаем практически идеальную картину: снижение Train loss и рост Validation Accuracy

Тестирование модели

Теперь протестируем нашу модель. Для этого:

Весь код, включая ресурсы для построения и запуска Docker контейнера со всеми нужными версиями библиотек, находятся в этом репозитории — на момент прочтения статьи код в репозитории может иметь обновления.

На воркшопе «Machine Learning и нейросети для разработчиков» я разберу и другие задачи машинного обучения, а студенты к концу интенсива сами представят свои проекты.

Переосмысление DTO в Java

Привет, Хабр! Представляю вашему вниманию любительский перевод статьи “Rethinking the Java DTO” Стивена Уотермана, где автор рассматривает интересный и нестандартный подход к использованию DTO в Java.

Я провел 12 недель в рамках программы подготовки выпускников Scott Logic, работая с другими выпускниками над внутренним проектом. И был момент, который застопорил меня больше других: структура и стиль написания наших DTO. Это вызывало массу споров и обсуждений на протяжении всего проекта, но в итоге я понял, что мне нравится использовать DTO.

Данный подход не является единственно верным решением, но он довольно интересный и отлично подходит для разработки с использованием современных IDE. Надеюсь, что изначальный шок пройдет и вам он тоже понравится.

Что такое DTO (Data Transfer Object)?

Зачастую, в клиент-серверных приложениях, данные на клиенте (слой представления) и на сервере (слой предметной области) структурируются по-разному. На стороне сервера это дает нам возможность комфортно хранить данные в базе данных или оптимизировать использование данных в угоду производительности, в то же время заниматься “user-friendly” отображением данных на клиенте, и, для серверной части, нужно найти способ как переводить данные из одного формата в другой. Конечно, существуют и другие архитектуры приложений, но мы остановимся на текущей в качестве упрощения. DTO-подобные объекты могут использоваться между любыми двумя слоями представления данных.

DTO — это так называемый value-object на стороне сервера, который хранит данные, используемые в слое представления. Мы разделим DTO на те, что мы используем при запросе (Request) и на те, что мы возвращаем в качестве ответа сервера (Response). В нашем случае, они автоматически сериализуются и десериализуются фреймворком Spring.

Представим, что у нас есть endpoint и DTO для запроса и ответа:

Что делают хорошие DTO?

Во-первых, очень важно понимать, что вы не обязаны использовать DTO. Это прежде всего паттерн и ваш код может работать отлично и без него.

Они также помогают документировать слой представления в человеко читаемом виде. Мне нравится использовать DTO и, я думаю, вы тоже могли бы их использовать, ведь это к тому же способствует уменьшению зацепления (decoupling) между слоем представления и предметным слоем, позволяя приложению быть более гибким и уменьшая сложность его дальнейшей разработки.

Тем не менее, не все DTO являются хорошими. Хорошие DTO помогают создавать API согласно лучшим практикам и в соответствии с принципам чистого кода.

Они должны позволять разработчикам писать API, которое внутренне согласовано. Описание параметра на одной из конечных точек (endpoint) должно применяться и к параметрам с тем же именем на всех связанных точках. В качестве примера, возьмём вышепредставленный фрагмент кода. Если поле price при запросе определено как “цена с НДС”, то и в ответе определение поля price не должно измениться. Согласованное API предотвращает ошибки, которые могли возникнуть из-за различий между конечными точками, и в то же время облегчает введение новых разработчиков в проект.

DTO должны быть надёжными и сводить к минимуму необходимость в написании шаблонного кода. Если при написании DTO легко допустить ошибку, то вам нужно прилагать дополнительные усилия, чтобы ваше API оставалось согласованным. DTO должны “легко читаться”, ведь даже если у нас есть хорошее описание данных из слоя представления — оно будет бесполезно, если его тяжело найти.

Давайте посмотрим на примеры DTO, а потом определим, соответствуют ли они нашим требованиям.

Покажи нам код!

Этот код на первый взгляд может показаться довольно странным, но не переживайте. В оставшейся части поста я объясню почему я остановился на данной реализации и какие преимущества она дает. Надеюсь, что вам станет всё понятно и вы оцените данный подход.

Он частично основывается на реальном коде из нашего проекта для выпускников, переведенный в контекст интернет-магазина. В нём каждый продукт имеет название, розничную и оптовую цену. Для хранения цены мы используем тип данных Double, но в реальных проектах вы должны использовать BigDecimal.

Мы создаем по одному файлу для каждого контроллера, который содержит базовый enum без значений, в нашем случае это ProductDTO. Внутри него, мы разделяем DTO на те, что относятся к запросам (Request) и на те, что относятся к ответу (Response). На каждый endpoint мы создаем по Request DTO и столько Response DTO сколько нам необходимо. В нашем случае у нас два Response DTO, где Public хранит данные для любого пользователя и Private который дополнительно содержит оптовую цену продукта.

Для каждого параметра мы создаем отдельный интерфейс с таким же именем. Каждый интерфейс содержит один-единственный метод — геттер для параметра, который он определяет. Любая валидация осуществляется через метод интерфейса. В нашем примере, аннотация @NotBlank проверяет что название продукта в DTO не содержит пустую строку.

Для каждого поля который входит в DTO мы реализовываем соответствующий интерфейс. В нашем случае аннотация @Value из библиотеки Lombok делает это за нас, автоматически генерируя геттеры.

Для полного сравнения, с использованием документации, вы можете посмотреть на примеры до и после. Также необходимо понимать, что это небольшие примеры и разница становится более наглядной как только вы начнете добавлять больше DTO.

“Это ужасно!”

Это на самом деле выглядит странно и здесь много необычных моментов. Давайте обсудим несколько из них подробнее.

Мы используем слишком много интерфейсов — по одному на каждый параметр! Мы делаем это потому что считаем данные интерфейсы единственным источником описательной информации относительно параметра который он определяет. Далее мы поговорим об этом чуть больше, но поверьте мне, это принесет свои плоды.

Мы не реализовали методы интерфейсов. Да, выглядит немного странно и я хотел бы найти решение получше. Сейчас мы используем автогенерацию геттеров при помощи Lombok для закрытия контракта и это небольшой хак. Выглядело бы лучше, если бы мы могли объявлять поля сразу в интерфейсе, что позволяло бы создавать DTO в одной строчке кода. Однако, в java нет возможности интерфейсам иметь не статические поля. Если вы будете использовать этот подход в других языках, то возможно ваш код будет более лаконичным.

Это (почти) идеально

Давайте вернемся к нашим требованиям к созданию хорошего DTO. Соотвествует ли им наш подход?

Согласованный синтаксис

Мы определенно улучшили согласованность синтаксиса и это главное почему мы могли бы начать использовать данный паттерн. Каждый API параметр теперь имеет свой синтаксис, определенный через интерфейс. Если DTO содержит опечатку в имени параметра или некорректный тип — код просто не скомпилируется и IDE выдаст вам ошибку. Для примера:

К тому же, когда мы используем валидацию на уровне интерфейса, мы исключаем ситуацию, когда один и тот же параметр на одном endpoint проходит валидацию и не проходит её на другом.

Согласованная семантика

Такой стиль написания DTO улучшает понимание кода через наследование документации. Каждый параметр имеет свою семантику которая определена в геттер методах соответствующего ему интерфейса. Пример:

Как только в DTO мы реализовали данный интерфейс, наша документация автоматически стала доступна через геттер.

Теперь вы гарантировано получаете актуальную и целостную документацию во всех DTO, которые реализовали данный интерфейс. В редких случаях, когда вам нужно добавить API, параметр с уже используемым наименованием и разной семантикой, вам придется создать отдельный интерфейс. Хоть это и неудобно, но заставляет разработчиков задуматься в таких ситуациях, а будущим читателям этого кода понять разницу между схожими параметрами.

Читабельность & Поддерживаемость

Будем честны: в нашем подходе достаточно много шаблонного кода. У нас есть 4 интерфейса, без которых не обойтись, и каждый DTO имеет длинную строку с перечислением интерфейсов. Мы можем вынести интерфейсы в отдельный пакет, что поможет избежать лишних “шумов” в коде c описанием DTO. Но даже после этого, бойлерплейт остается главным недостатком данного подхода, что может оказаться веской причиной для того чтобы использовать другой стиль. Для меня, эти затраты все еще стоят того.

К тому же, мы видим всю структуру наших DTO классов. Посмотрите на код и вы увидите все что вам нужно знать из сигнатуры класса. Каждое поле указано в списке реализованных интерфейсов. Достаточно нажать ctrl + q в IntelliJ и вы увидите список полей.

В нашем подходе мы пишем валидацию единоразово, т.к. она реализуется через методы интерфейса. Создали новое DTO — получили валидацию в подарок, после реализации интерфейса.

И в заключении, благодаря нашим интерфейсам, мы способны писать переиспользуемые утилитные методы. В качестве примера, рассмотрим ситуацию, когда нам нужно посчитать наценку на товар:

В java, мы можем реализовать это используя обобщение:

Вывод

Я не жду, что вы сразу же пойдете переписывать все ваши DTO. Но есть несколько деталей которые вы можете почерпнуть для себя:

Работают ли «чужие» инновации?

Трансфер технологий является эффективной методикой передачи разработок, услуг физическим лицам, компаниям-партнерам на выгодных условиях (соглашение, контракт) при реализации инновационных разработок. Метод включен в процесс продвижения и увеличения производственных мощностей предприятий.

Роль трансфера технологий в развитии инновационной экономики

Важной составляющей оперативной передачи разработки, рецепта, схемы между подразделениями холдинга либо партнерскими компаниями является трансферт технологий. Метод позволяет наращивать производственные мощности, увеличивать скорость выхода продукта на рынок, повышать конкурентоспособность предприятия и т.д.

Трансфер обеспечивает перемещение научных разработок от исследовательского отдела к производственному, поддерживая быстрые темпы интеграции изобретений.

Метод позволяет осуществлять взаимодействие между лабораторными комплексами, исследовательскими институтами, прикладными и академическими подразделениями, позволяя корректировать производственные процессы после передачи результатов научной деятельности, снижать себестоимость продукции и т.д.

Характеристики

В инновационной деятельности трансфер технологий является методом передачи концепций, схем другому носителю (компания, физлицо).

В состав понятия включены:

В крупных компаниях управление процессами трансферта технологий осуществляется с помощью отделов, отвечающих за выявление и учет разработок, юридическую защиту схем, образцов, обладающих коммерческой значимостью.

По сфере передачи различаются формы трансферта:

Передача сведений между цехами, отделами предприятия позволяет оптимизировать производственный процесс, сроки выпуска новой продукции, обеспечивает конкурентное преимущество компании.

Трансфер квазивнутренний позволяет перемещать разработки, изобретения, рецептуру между компаниями, объединенными в союз, альянс и т.д. Методика помогает решать задачи по выходу объединения на ведущие позиции в отрасли.

Во внешней передаче сведений принимают участие разработчики инновации и компании, физлица, заинтересованные в практическом применении знаний.

В соответствии с видом данных, использующихся в трансфере, определяют сведения:

Перевод разработок субъектам соглашения осуществляется в разных экономико-правовых форматах:

Передача лицензий на технологию, состав, метод применяется разработчиками при превышении прибыли от сделки над монопольным производством продукции. Лицензия на технологию становится продуктом при оформленной техдокументации и подписании договора.

Ноу-хау переводится сторонам соглашения в формате беспатентной лицензии между предприятиями холдинга, структурами компании. Необходимо предотвращать доступность информации до подписания договора.

Инжиниринговый трансфер позволяет на договорной основе предоставлять услуги инженерно-технического характера, оказывать помощь в проектировании, монтаже оборудования для компаний-заказчиков. Консультативная помощь необходима при выпуске инновационного продукта на предприятиях с нехваткой квалифицированных кадров. Специалисты выполняют координирование проектов либо выполняют комплексные работы.

Кооперация промышленных предприятий позволяет выполнять оперативный обмен технологиями, методами для ускорения вывода продукта на рынок, увеличения объема производства и прибыли. Метод кооперирования позволяет создать серийный выпуск продукта, повысить уровень компетенции предприятий.

Франшизой является переуступка либо перевод на основании коммерческого соглашения реализации продукции, оказания услуг. Метод передачи инновации отличается гибкостью, мобильностью, обеспечивает быстрый рост дохода и расширение мощностей предприятия.

Лизинг позволяет передавать технически сложные агрегаты с системами авторской разработки на площадках, эксплуатируемых с коммерческими и промышленными целями. Право собственности на технику остается у компании-арендодателя. В контракте указывается период найма оборудования, правила, ежемесячный размер взносов, гарантии.

Популярным методом трансфера является техпомощь, которая становится главным предметом договора либо включена в соглашение о переводе комплекса технологий или установки сложных агрегатов и оборудования.

Для вывода продукта на крупные рынки требуется объединение компаний, которые могут перенимать информацию, схемы работы, исследовательские разработки. Совместная деятельность позволяет нарастить объемы производства, снизить финансовые риски.

Этапы трансфера технологий

Трансфер инноваций выполняется поэтапно и включает:

На этапе инвентаризации выполняется учет объекта технической собственности фирмы. В компании фиксируются патентные данные, методы, осуществляется юридическое оформление разработки.

При оценке инновации определяется коммерческая перспектива от внедрения продукта, назначается цена и т.д.

На этапе определения способа правовой безопасности открытия выбирается оптимальная схема (оформление авторских прав, регистрирование патента и т.д.).

При подборе формы перевода технологии по договору и модели проталкивания учитывается надежность сохранения данных, планы и возможности разработчика, размеры прибыли и т.д.

Определение потенциальных заказчиков, составление плана вывода продукта на рынок осуществляется через специальные отделы, взаимодействие на конференциях и т.д.

Завешается трансфер подписанием договора и переводом данных, обучением сотрудников, установкой и запуском оборудования.

Что такое transfer метод

Transfer Learning (трансферное обучение) — это подраздел машинного обучения, целью которого является применение знаний, полученные из одной задачи, к другой целевой задаче. Существует множество решений, который могут помочь Data Scientist’у применить его к своей проблеме, поэтому нет необходимости изобретать велосипед.

Например, знания, полученные при обучении классификации статей Википедии, можно использовать для решения задачи классификации медицинских текстов. Можно пойти дальше, и использовать модель, обученную для решения классификации автомобилей, чтобы распознавать птиц в небе, как одну из задач компьютерного зрения (Computer Vision).

История Transfer Learning

История трансферного обучения восходит к 1993 году. В своей статье «Передача между нейронными сетями на основе различимости (англ. Discriminability-Based Transfer between Neural Networks)» Lorien Pratt открыла ящик Пандоры и представила миру потенциал трансферного обучения [1]. В июле 1997 года журнал Machine Learning опубликовал серию статей о трансферном обучении [2]. По мере развития смежные области, например многозадачное обучение (multi-task learning), также были включены в трансферное обучение. Сегодня Transfer Learning является мощным инструментом искусственного интеллекта. Andrew Ng предсказывает подъём трансферного обучения с точки зрения коммерческого успеха [3].

Как работает Transfer Learning

Прежде всего стоит обратить внимание на 2 аспекта при использовании Transfer Learning:

Предварительно обученная модель — это модель, созданная и обученная кем-то другим для решения проблемы, аналогичной нашей. На практике кто-то, имея большие вычислительные ресурсы, они конструируют большую нейронную сеть для решения конкретной проблемы, тренируют её на большом наборе данных (Big Data), например ImageNet или Wikipedia Corpus. Так, например, VGG19 имеет 143.667.240 параметров и используется для классификации изображений. Под «открытой» моделью мы подразумеваем, что она обнародована, и её можно свободно использовать.

Ресурсы с предварительно обученными моделями:

В редких случаях предварительно обученные модели хорошо работают для целевой задачи. Как правило, их необходимо поднастроить по следующим причинам:

Предварительно обученные сети используются для дообучения (fine-tuning) или выделения признаков (feature extraction).

Дообучение

В архитектурах Deep Learning начальные слои изучают общую информацию, а слои на последнем уровне более специфичные признаки. Например, первые слои запониманют текстуру, цвет, общую картину, а последние слои глаза, рот, родинки и т.д. Многие модели обучены на всевозможных ситуациях, например, ImageNet содержит 1 миллион изображений с 1000 классами, поэтому нет необходимости изменять общую картину, которую видит текущая модель. Вместо этого полезнее дополнить новыми конкретными признаками, дообучив только последние слои, чтобы перепрофилировать её для собственных нужд.

Затрагивая больше слоев для дообучения, повышается риск переобучения (overfitting). Например, модель VGG19 может после полного переобучения показать непредсказуемые результаты в рамках Transfer Learning, причем не в пользу Data Scientist’а. Поэтому часто обходятся двумя-тремя последними слоями.

Выделение признаков

Для выделения признаков используются представления, полученные предыдущей моделью, для извлечения признаков из новых образцов, которые затем пропускаются через новый классификатор. В этом методе просто добавляется классификатор, который будет обучаться с нуля, поверх предварительно обученной модели для решения целевой функции.

В сверточные архитектуры нейронных сетей (CNN) обычно состоят из двух частей: сверточной и полносвязной. Для выделения признаков (feature extraction) сверточная часть остаётся неизменной. В то время как Fine Tuning захватывает несколько последних сверточных слоев.

Сверточная основа не используется по причине их универсальности. Так, например, они имеют представления о присутствии объектов и их местоположении. С другой стороны, полносвязные слои не имеют знаний о местоположении объектов, т.е. не обладают свойством инвариантности, поэтому их безбоязненно можно поменять на собственные.

Выделение признаков в Transfer Learning реализуется двумя способами:

Что выбрать дообучение или выделение признаков

Оба метода могут повысить точность модели, но при условии наличия достаточного объёма данных, в противном случае сеть не «почувствует» изменений от нового набора данных и не сможет перепрофилироваться.

Выделение признаков применяется в том случае, когда решаемая задача прошлой сети схожа с целевой. А вот если есть существенные отличия, то используется дообучение, которое является более затратной с вычислительной точки зрения.